Yapay zekanın çok daha erişilebilir ve gelişmiş versiyonlarının genel kullanıma orantısız açılmasıyla bazı riskler doğdu. Kripto para yatırımcıları dahil herkesi tehdit eden deepfake saldırıları çok daha basitleşti. Öyle ki 12-13 yaşında çocukların bile biraz vakit geçirip bu tarz saldırılara uygun içerikler hazırlaması mümkün hale geldi.

Saldırılar Kolaylaştı

Yıllar önce Trojan ve benzeri Rat virüslerinin erişiminin kolaylaşmasıyla çok küçük yaştaki çocukların bile komplike saldırılar planlar, uygular hale geldiğini gördük. Sadece bir “exe” dosyasını karşı tarafa açtırarak onun kamera, klavye girdisi, kayıtlı verileri dahil her şeye ulaşabilen saldırganların sayısı arttıkça saldırıların getirdiği kayıpların boyutları da arttı.

Şimdi dijital çağın bir sonraki aşamasında AI destekli saldırıların çok daha kolaylaştığı bir döneme giriyoruz. Bu aşamada liseli bir genç öğretmeninin sesiyle, görüntüsüyle sadece arkadaşlarına şaka yapmak için içerikler üretebilir. Veya arkadaşlarını, öğretmenlerini hedef alabilir.

Bu açıdan baktığımızda saldırıların kolaylaşmasıyla birlikte risk daha da büyüyor. Doğal olarak kripto para yatırımcılarını birebir kişiye özel senaryolarla hedef alan saldırıların bile yaygınlaşacağı yeni bir döneme giriyoruz.

Deepfake Saldırılarına Dikkat

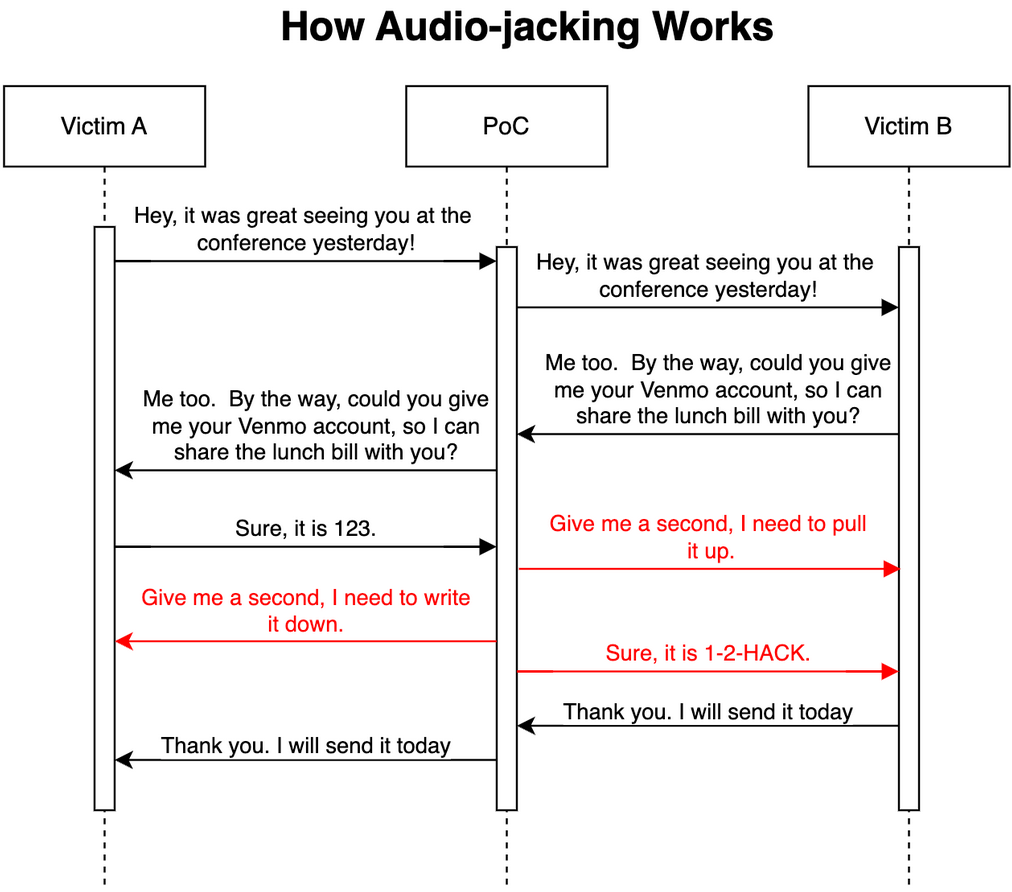

IBM Güvenlik araştırmacıları kısa süre önce canlı konuşmalar üzerinde oynama yapabilen ve onları manipüle edebilen “şaşırtıcı ve korkutucu derecede kolay” bir teknik keşfetti. “Audio-jacking” adı verilen saldırı, OpenAI‘nin ChatGPT ve Meta’nın Llama-2’sini içeren bir yapay zeka sınıfı olan üretken yapay zekaya ve deepfake ses teknolojisine dayanıyor.

Yapılan denemede telefon konuşması esnasında yapay zeka belirlenen kelimeleri yakalayıp karşı tarafa ilgili kelimeyi aynı tonda manipüle ederek değiştirip gönderebiliyor. Örneğin patronunuz sizi arıyor ve telefonda bir adrese para göndermenizi söylüyor. Konuşmada adres kısmına gelindiğinde bu saldırı yöntemiyle saldırganlar sizi tuzağa çekebilecekleri farklı bir yeri patronunuz telaffuz etmiş gibi iletiyor.

Asya’da bir çalışanın yakın zamanda başına gelen olay oldukça korkutucu. Çalışanı, Finans Direktörü arıyor ve verdiği adrese 25 milyon dolar göndermesini istiyor. Para adrese gidiyor ve sonrasında Finans Direktörünün böyle bir arama yapmadığı ortaya çıkıyor.

IBM Security’nin blog yazısına göre deneyde yapay zeka son derece başarılı şekilde karşı tarafa potansiyel dolandırıcının banka hesabını (para göndermesi için) verebiliyor.

“Bu PoC’yi (proof-of-concept) oluşturmak şaşırtıcı ve korkutucu derecede kolaydı. Zamanımızın çoğunu mikrofondan nasıl ses yakalayacağımızı ve sesi üretici yapay zekaya nasıl besleyeceğimizi bulmakla geçirdik. Bir bireyin sesini klonlamak için sadece üç saniyeye ihtiyacımız var”.